Midjourney 5.2: „Zoom out“ vs. Photoshops Bilderweiterung mit generativer Füllung

Der KI-Bildgenerator Midjourney bringt mit der neuen Version neue, lang gewünschte Funktionen. Eine Übersicht und persönliche Einschätzung von Olaf Giermann.

Neu in Midjourney 5.2

Die wichtigsten Neuerungen der Version 5.2 (Betaversion, also noch nicht final):

- »Zoom out«: das Erweitern eines bereits erzeugten Bildes (mehr dazu unten)

- verbessertes Textverständnis (merke ich noch nicht so richtig, wird sich zeigen)

- Der Parameter »– stylize« soll zwischen der Parameter-Range von 0 bis 100 einen stärkeren Einfluss auf das Bild haben (mehr dazu unten).

- Der neue Standard »High variation mode« erzeugt unterschiedlichere Bilder für einen Prompt. Durch mehrmaliges Generieren mit demselben Prompt findet man so eventuell schneller das gesuchte Ergebnis.

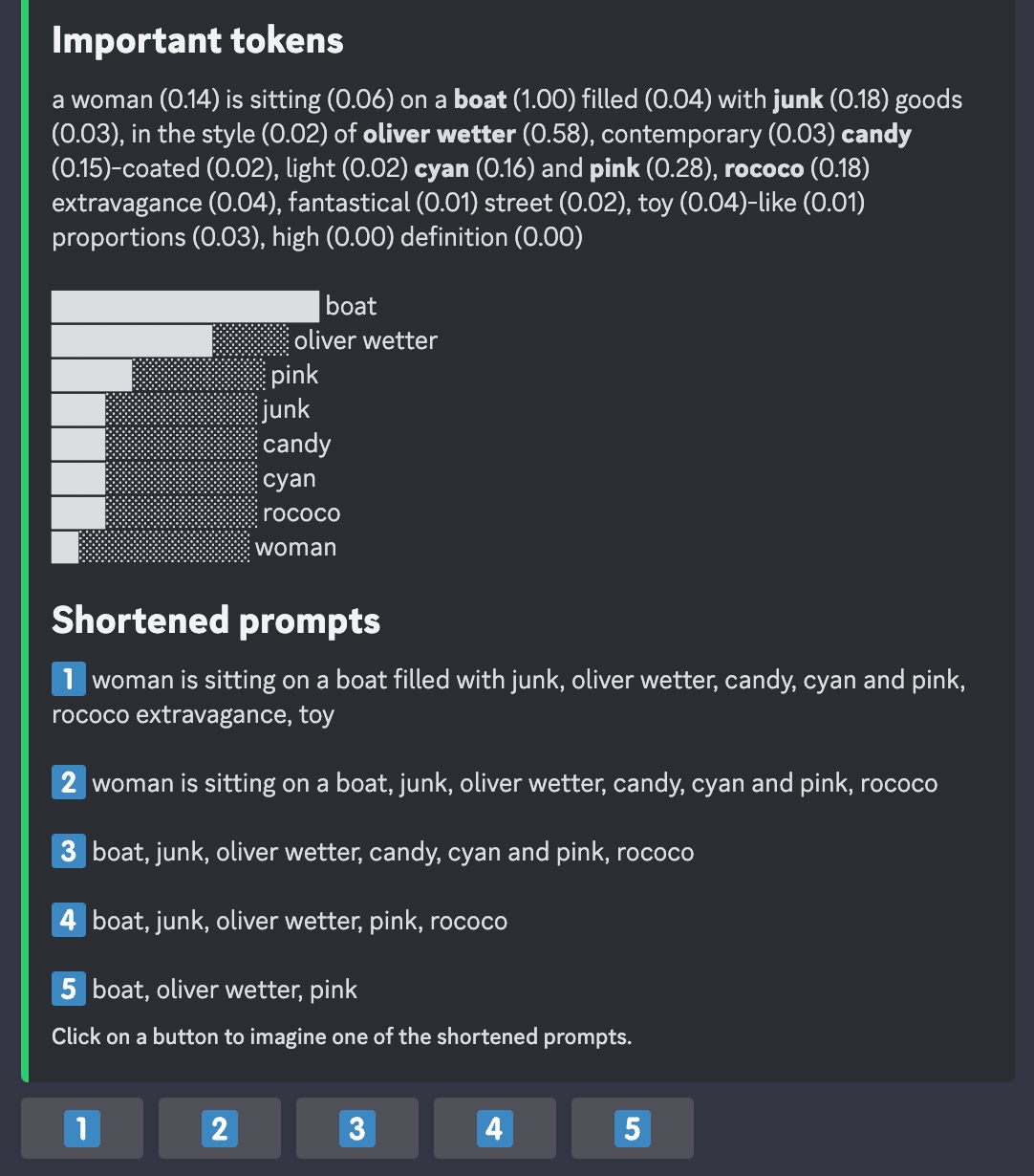

- Der Befehl »/shorten« untersucht einkopierte Prompts und zeigt an, welche Wörter eines Prompts sich tatsächlich auf das Ergebnis auswirken oder eben nicht. Das hilft bei der Prompt-Analyse und -Optimierung.

Version 5.2 ist standardmäßig aktiv, Sie können wie gehabt über den Befehl »/settings« zu allen vorigen Versionen wechseln.

Midjourney: Zoom out

»Zoom out« ist Midjourneys Version von „Outpainting“ – also dem Erweitern eines vorhandenen Bildes. Um echtes Outpainting handelt es sich jedoch nicht, da die Bildabmessungen nicht größer werden. Dadurch erklärt sich auch die ungewöhnliche Benennung. Es ist eben tatsächlich ein Herauszoomen. So, als wenn Sie bei gleichem Objektiv statt einer APSC-Kamera eine Voll- oder Mittelformat-Kamera bei gleicher Sensor-Auflösung verwenden würden. Sie können dementsprechend um den Faktor 1,5 oder 2 „herauszoomen“. Das bedeutet, Sie sehen mehr drumherum, weil das Bild „weitwinkliger“ wird, gewinnen aber keine Auflösung hinzu.

Toll:

- Das erzeugte Bild wird nicht verändert, sondern glaubhaft an den Bildrändern erweitert.

- Die Ergebnisse überzeugen (tolle Beispiele in diesem Twitter-Thread)

Nicht so toll:

- »Zoom out« vergrößert nicht die von Midjourney erzeugte Maximalauflösung. Wenn Sie also aus einem Bild mit 1024 × 1024 Pixeln „herauszoomen“, ist es danach immer noch nur 1024 × 1024 Pixel groß.

- Das Ändern des Seitenverhältnisses liefert oft unbrauchbare Ergebnisse (siehe diesen Beitrag von Petapixel)

- Die neuen Zoom-Befehle stehen nur für neu generierte Bilder zur Verfügung. Ältere Bilder lassen sich in Midjourney damit nicht erweitern.

Vergleich zur generativen Füllung in Photoshop

Mit der generativen Füllung von Photoshop erhält man also tatsächlich größere Bilder als das Ausgangsbild. Hinzu kommt noch, dass man in Photoshop jetzt schon durch das „kachelweise“ Rendern von Ausschnitten von 1024 × 1024 Pixeln wirklich hochauflösend „anstricken“ kann. Man erhält also wirklich brauchbare Auflösungen, selbst für größere Ausdrucke. Ich gehe davon aus, dass Adobe diese umständliche Übergangslösung bis zur finalen Veröffentlichung vereinfachen wird.

Beim Realismus von eher fotografischen und weniger künstlerischen Motiven – insbesondere bei Tieren und Personen – ist Midjourney der Adobe-Lösung (die noch in der Beta-Phase ist!) dennoch einige Monate voraus. Im Zweifel würde ich momentan immer zunächst in Midjourney generieren, in Photoshop Beta erweitern und das Ergebnis in Topaz Sharpen AI nachschärfen. Das erzeugt in geschätzt 80 Prozent aller Fälle die besten Ergebnisse. Nächste Woche kann das aber schon wieder ganz anders aussehen. Also dranbleiben! 😉

Midjourney: Stylize

Mit dem Parameter »Stylize« weisen Sie Midjourney an, mehr oder weniger künstlerisch wirkende Bilder zu erzeugen. Höhere Werte (Maximum: --stylize 1000) sollen dabei „künstlerische“ Farben, Kompostionen und Formen bevorzugen, während kleinere (--stylize 0) eher dem Prompt entsprechen sollen. In der Regel bedeutet das aber nur, dass höhere Werte für »stylize« ansehnlichere und detailreichere Bilder erzeugen. Der Standard ist hier 100. Dabei würde ich es auch beim Herumprobieren immer zunächst belassen, bis Sie speziellere Variationen erzeugen möchten. Einen großen Unterschied zur Vorversion bemerke ich hier insofern, dass der Parameter tatsächlich mehr oder weniger komische Ergebnisse erzeugt. Bei der Vorversion gab es keine so große Bandbreite.

Midjourney: Shorten

Wie zuvor erwähnt: Der Befehl »/shorten« untersucht einkopierte Prompts und zeigt an, welche Wörter eines Prompts sich wirklich auf das Ergebnis auswirken oder eben nicht. Das hilft bei der Prompt-Analyse und -Optimierung. Ein Beispiel:

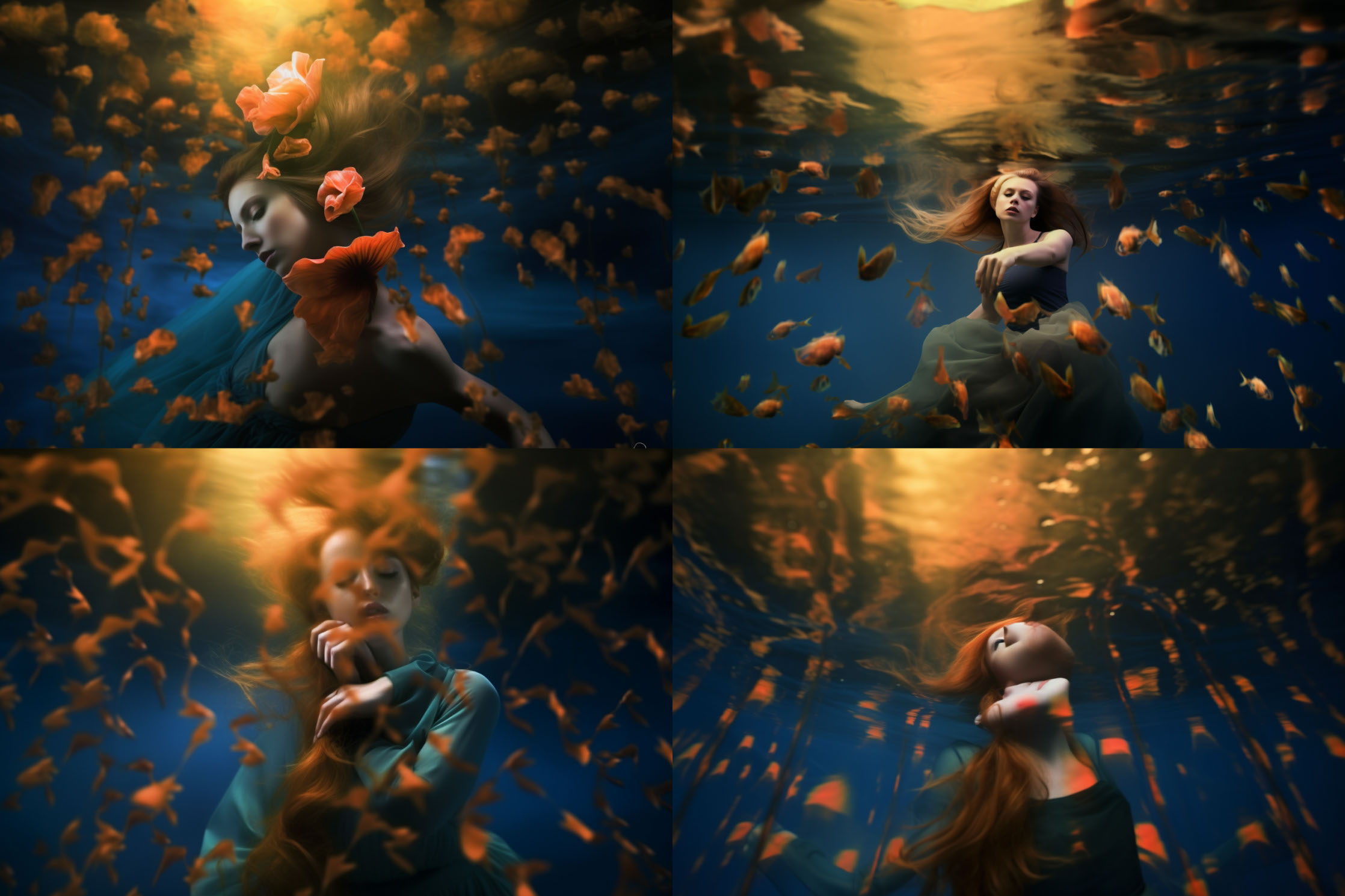

Das obige Bild habe ich mit dem Prompt a woman is sitting on a boat filled with junk goods, in the style of oliver wetter, contemporary candy-coated, light cyan and pink, rococo extravagance, fantastical street, toy-like proportions, high definition --ar 2:3 --q 2 --v 5 --s 750

in Midjourney 5.2 erzeugt. Hat einwandfrei funktioniert. Aber was davon spielte für Midjourney tatsächlich eine Rolle? Die Prompt-Analyse mit Einblendung der Einfluss-Statistik ergibt Folgendes:

Die fünf Vorschläge verkürzen den ersten, langen Prompt zunehmend.

Prompt 1 mit 18 Wörtern rendert in Midjourney-Version 5.2 diese Ergebnisse:

Prompt 5 mit nur vier Wörtern diese:

Sie erhalten durch diese Prompt-Verkürzungen nicht nur mehr Variation und damit „Happy Accidents“, sondern lernen mit der Zeit auch, worauf Midjourney ganz besonders Wert legt.

Aber auch hier gilt: Was „der Experte“ JETZT weiß, kann morgen schon wieder anders sein. Umso wichtiger ist es, die Prinzipien der generativen Bilderstellung zu verstehen – die jetzigen Prompts und Parameter können schon morgen nicht mehr wie gewohnt funktionieren.

Nie waren wir im Hinblick auf konstantes Lernen näher an Heraklits „Panta rhei!“ 😉

In diesem Sinne,

Olaf Giermann

Sehr schöner Artikel und auch spannend ähnliche (oder sogar die gleichen) Experimente durchzuführen.

Ich selbst bin auf Leonardo_AI unterwegs und habe ähnliche Ergebnisse mit ähnlichen Abstufungen erzielt.

Auch wenn jetzt schon länger auf dem Markt wird das noch lange nicht beendet sein. Den letzten Absatz kann ich nur unterschreiben. Auch wenn ich fast täglich experimentiere, so gibt es immer wieder neues zu erlernen. Wahrscheinlich auch ein Grund, warum die „Happy Accidents“ so willkommen sind.