KI-Prompt Inspiration: Describe

Wie formuliert man einen KI-Prompt richtig? Nun, klare Regeln gibt es (noch) nicht, aber einige Experten haben inzwischen Systeme erdacht, wie man vorgehen kann. In der nächsten DOCMA werden wir dazu einen ausführlichen Beitrag bringen. Aber was macht man ohne solch ein System? Einfach sprachlich loslegen, wie einem der Schnabel gewachsen ist? Das funktioniert zwar, aber meist nur, wenn die eigenen Ansprüche nicht sonderlich hoch sind.

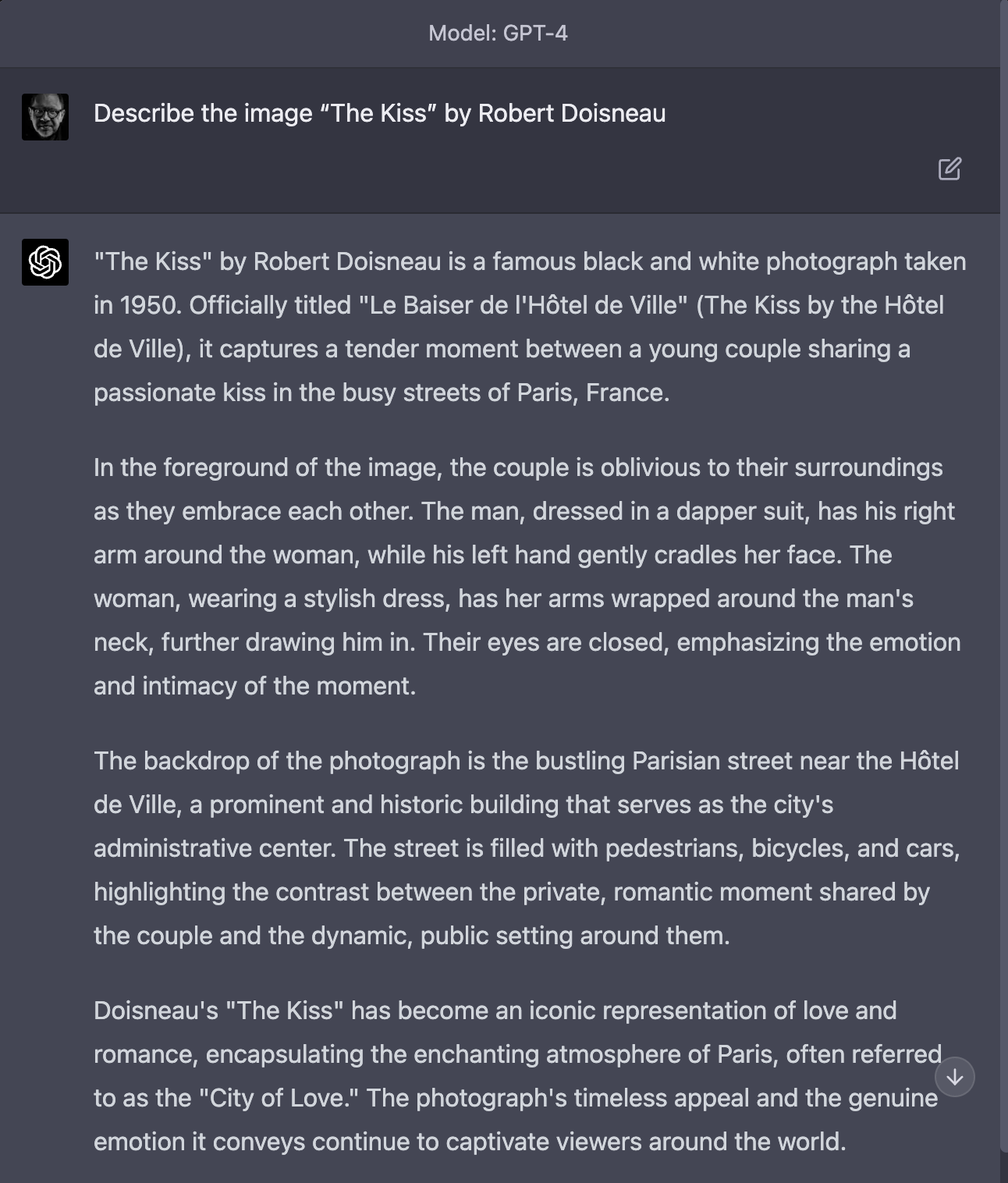

KI-Bildbeschreibung mit ChatGPT

Alternativen? Sich von einer anderen KI helfen lassen. So kann man etwa Bilder, die sehr bekannt sind, und einen eindeutigen Titel haben, von ChatGPT beschreiben lassen. Natürlich möglichst gleich in englischer Sprache, damit man das Ergebnis direkt in ein Text-2-Image-System kopieren kann. Ein Beispiel: „Der Kuss“ von Robert Doisneau

Ganz so einfach mit Copy und Paste geht das allerdings doch nicht, aber man bekommt durch Kürzungen dennoch schnell einen brauchbaren Text-Prompt:

Wir sehen: Die Idee funktioniert im Prinzip, die Bilder haben entfernt mit dem Original zu tun – zumindest thematisch. Aber auf Details sollte man nicht zu sehr achten.

KI-Bildbeschreibung mit Midjourney

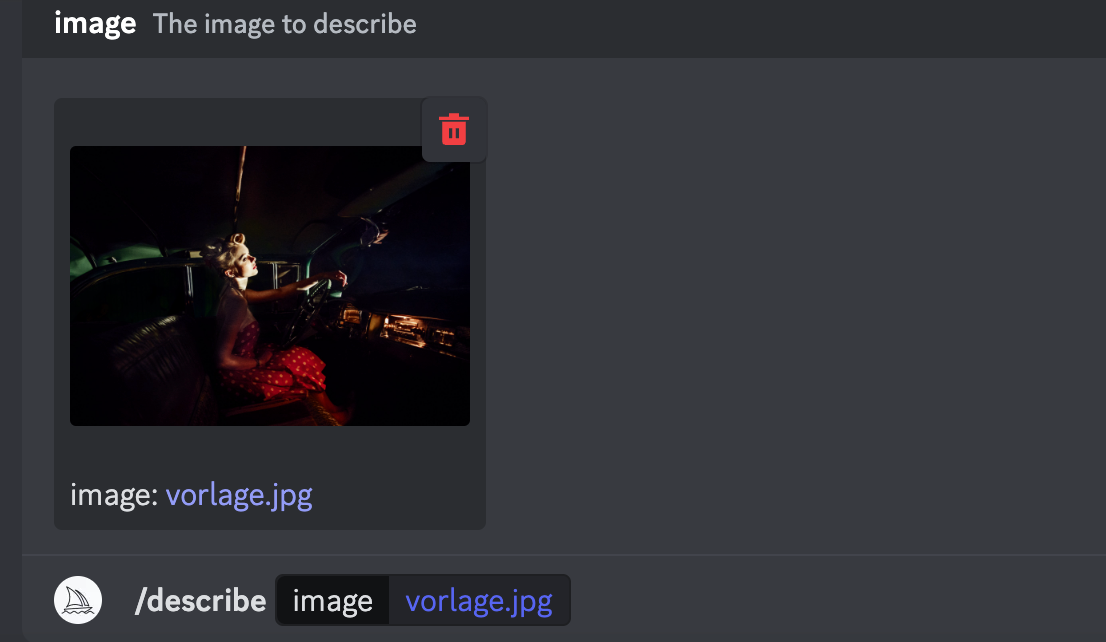

Seit ein paar Tagen hat nun auch Midjourney eine Bildbeschreibungs-Funktion. Allerdings ist man dort nicht auf bekannte Bilder mit eindeutigen Titeln angewiesen, sondern kann einfach eigene Motive hochladen und sie sich beschreiben lassen. Der Befehl dazu lautet: »/describe [BILD]«

Zu sehen ist eine Frau nachts in einem Auto. Schauen wir mal, was Midjourneys neuer Befehl daraus macht …

Kleiner Hinweis: Bilder mit viel Haut mag das System gar nicht und verweigert die Beschreibung. Also bitte nur züchtige Motive verwenden.

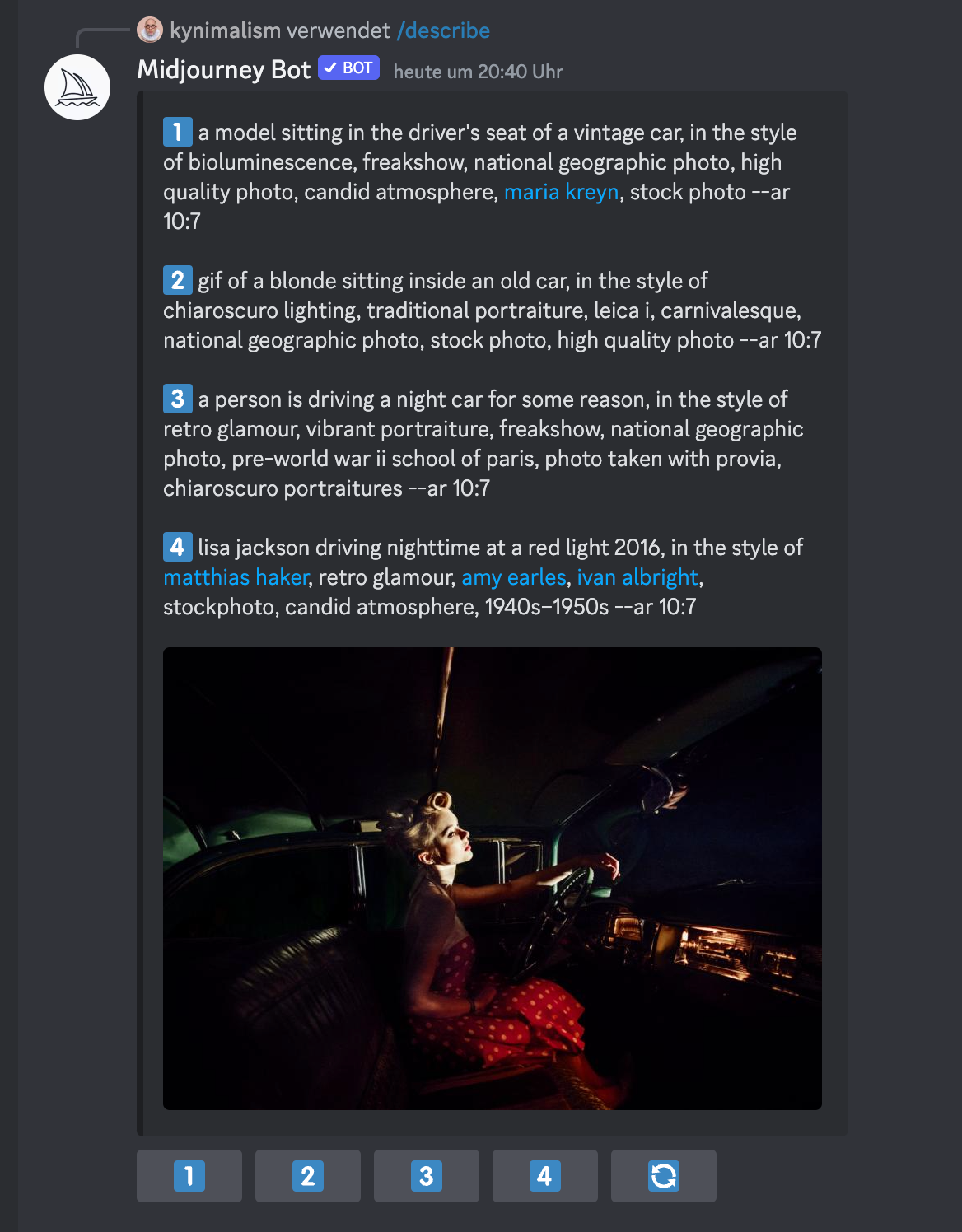

Midjourney hat vier Beschreibungen erzeugt, die man per Klick auf das jeweilige Zahlenfeld berechnen lassen kann.

Thema getroffen, aber der Teil des Konzepts, der beschreibt, was man mit seinen Händen beim Autofahren tut, ist hier und bei den meisten anderen noch ein wenig trainingsbedürftig.

Insgesamt recht gut getroffen – selbst die Darstellung des Autofahrens.

Kennt jemand „Lisa Jackson“? Ich habe bei Google nur eine Autorin gefunden, aber die sieht ganz anders aus. In jedem Fall ist Lisa keine passionierte Chauffeurin.

Abgesehen von Details zeigt sich deutlich: Zumindest bei diesem Beispiel hat die Inhalts- und Stilübertragung ganz ordentlich funktioniert. Andere Test-Bespiele haben den Eindruck verfestigt. Die neue „Describe“-Funktion von Midjourney scheint also ein brauchbarer Ansatz zu sein, um das Bescheibungs-Prompt-Problem besser in den Griff zu bekommen.

Zum Vergleich: ein Versuch mit dem Kuss von Robert Doisneau

Das erinnert sehr an die Bilder oben.

Bunt und im Look eher an ein kommunistisches Klassenkampfepos erinnernd.

Schon näher am Ziel! Vor allem deshalb, weil sich der Kamerastandpunkt etwas nach hinten verlagert hat und man mehr von dem Paar sieht.

Der eher knappe Prompt führt nicht zu treffenderen Resultaten.

Aus den Bildern kann man schließen, dass die Lerndatenbank mit vielen Köpfen und nur wenigen Autos gespeist wurde. Man sieht viele verkrümmte und unmögliche Lenkräder, doch keine verbogene Nase.

So geschieht es eben, wenn man nichts, absolut nichts erkennt.

KI ist eben ein Synonym für natürliche Dummheit.

Mit Lisa Jackson könnte sie gemeint sein: https://www.gettyimages.de/fotos/lisa-jackson-model

Aber wieso erkennt Midjourney da ein GIF? Und soll mit „leica i“ die Leica I von 1925 gemeint sein? Aber was spräche dann dafür, dass das Bild mit einer Schraubleica entstanden wäre?

Naja die KI kann mal besser mal schlechter sein, bei den sich küssenden sieht man in einem Bild wie zwei Nasen sehr künstlerisch sich verschmelzen. Sieht sehr nach Salvador Dali aus.

Ich würde mir wünschen, dass DOCMA den lächerlichen Hype-Begriff „Prompt“ in diesem Zusammenhang vermeidet. Ein Prompt ist seit etwa 50 Jahren (oder länger?) eine „Eingabeaufforderung“ von Computer-Benutzerinterfaces, so auch bei den heute gängigen KIs. Es wird damit also keinesfalls das bezeichnet, was man da eingibt, sondern lediglich der Hinweis einer Maschine, dass man nun etwas eingeben kann. Zudem werden sich die KIs zunehmend zu Dialogsystemen weiterentwickeln. Der Begriff passt somit immer weniger.

Die Anweisungen bzw. bei einigen KIs den Dialog „Prompt“ zu nennen, ist in etwa so sinnvoll, wie ein Mobiltelefon als „Handy“ zu titulieren. Klingt wie eine Englische Bezeichnung, ist es aber nicht. Hat sich in vielen deutschen Kreisen leider trotzdem durchgesetzt – auch durch die Medien, entstand aber aus falschem Verständnis. Ein Mobiltelefon kann durchaus „handy“ (praktisch/handlich) sein – das ist aber nicht die Bezeichnung des Gerätes, sondern eine seiner Eigenschaften. Heute denkt die Welt, das sei ein urdeutscher Begriff.

Mit Klarheit in der Sprache geht Verständnis los. Wir können natürlich auch darauf warten, bis eine KI uns das erklärt… 😉

ChatGPT4 sagt dazu übrigens:

„Ein Prompt ist ein Zeichen oder eine Anzeige auf einem Computer oder einer mobilen Anwendung, die den Benutzer auffordert, eine Aktion auszuführen oder eine Eingabe zu machen. Ein häufiges Beispiel für einen Prompt ist das Eingabeaufforderungsfenster in einem Betriebssystem oder einer Programmiersprache, in dem Benutzer Befehle eingeben können. Prompts können auch in Form von Dialogfeldern oder Pop-ups erscheinen und den Benutzer auffordern, eine Entscheidung zu treffen oder eine Information zu geben.

Tatsächlich ist ein Prompt eine Aufforderung oder Eingabeaufforderung, die von einer Maschine, einschließlich eines Computers oder einer KI, an den Benutzer gerichtet wird. Es handelt sich um ein Signal oder eine Meldung, die darauf wartet, dass der Benutzer eine Eingabe tätigt, wie zum Beispiel eine Antwort auf eine Frage oder eine Eingabeaufforderung zur Ausführung einer bestimmten Aktion. Ein Beispiel für einen Prompt in Bezug auf eine KI wäre eine Frage wie „Was möchten Sie tun?“ oder eine Anweisung wie „Bitte sagen Sie ‚ja‘ oder ’nein'“.“

ChatGPT4 zur Verwendung des Begriffes: 😉

Es gibt möglicherweise mehrere Gründe, warum einige Menschen den Begriff „Prompt“ falsch verwenden. Hier sind einige mögliche Gründe:

1. Mangelnde Kenntnisse: Einige Menschen haben möglicherweise nicht genügend Kenntnisse über die Technologie und die korrekten Fachbegriffe. Aus diesem Grund können sie den Begriff „Prompt“ fälschlicherweise verwenden.

2. Verwechslung mit anderen Begriffen: Einige Menschen können den Begriff „Prompt“ mit anderen ähnlichen Begriffen wie „Befehl“ oder „Anweisung“ verwechseln, was zu einer falschen Verwendung führen kann.

3. Verwendung in verschiedenen Kontexten: Der Begriff „Prompt“ wird in verschiedenen Kontexten verwendet, z. B. in der Programmierung, in der Benutzeroberfläche und in der Künstlichen Intelligenz. Einige Menschen können den Begriff möglicherweise in einem Kontext gehört oder gelernt haben und ihn dann in einem anderen Kontext falsch verwenden.

Insgesamt kann die Verwendung von Fachbegriffen wie „Prompt“ manchmal verwirrend sein, insbesondere wenn sie in verschiedenen Kontexten verwendet werden. Es ist jedoch wichtig, die richtigen Begriffe zu verwenden, um Missverständnisse zu vermeiden und eine klare Kommunikation zu gewährleisten.

Wir verwenden den Begriff „Prompt“, weil das in der englischen Fachsprache nun mal so heißt und noch niemandem ein guter deutscher Begriff dafür eingefallen ist (so weit ich weiß). Auch in Zusammensetzungen wie „prompt engineering“ kommt das Wort vor. Das englische „Prompt“ kann unter anderem „Abfrage“, „Vorgabe“, „Anstoß“ oder „Stichwort“ (im Theater – das Stichwort, das eine Souffleuse einem Schauspieler gibt) bedeuten, und die Verwendung dieses Wortes im Bereich der generativen KI lag daher nahe – es passt einfach. (Die Antwort, die Sie von ChatGPT bekommen haben, führt in die Irre, da sie nur eine sehr spezielle und nicht die ursprüngliche Bedeutung des Wortes erwähnt. „Prompt“ im Sinne einer Eingabeaufforderung eines Computers an einen Benutzer ist ja selbst eine relativ junge, erst gut 50 Jahre alte Lesart, während das Wort sehr viel älter – älter als der Computer – ist. Es geht auf das lateinische „promo“ zurück, das „hervorholen“ oder auch „an den Tag bringen“ bedeuten kann. Auf den Wahrheitsgehalt von ChatGPT-Auskünften kann man sich eben nicht verlassen.)

Man kann natürlich versuchen, eigene Bezeichnungen zu prägen, wenn einem die Gebräuchlichen nicht gefallen, aber meist greift das dann niemand auf, und wenn man darauf insistiert, wirkt man irgendwann sonderlich. Und wir haben ja nicht einmal ein Problem mit dem Wort „Prompt“, weshalb wir es auch in Zukunft weiter verwenden werden.