Ist KI intelligent, aber nicht kreativ?

Doc Baumann hat jüngst in seinem Editorial zum Thema „Bilder, Texte und Roboter“ über die Aussicht geschrieben, künstlich intelligente Computersysteme könnten uns künftig nicht nur lästige Arbeit abnehmen („Einmal freistellen bitte!“), sondern auch eigenständig Bilder erschaffen. Aber kann ein Computer wirklich schöpferisch sein?

Unser Leser Andre Möschter jedenfalls stellt diese für ihn allzu pessimistische Einschätzung in Frage:

„Künstlerische Arbeit ist immer mehrdimensional und kombiniert bewusst oder unbewusst verschiedene Aspekte auf mehreren Ebenen. Auf eine solche Arbeitsweise werden wir bei Computern, wegen der extrem hohen Komplexizität solcher Vorgänge, noch lange warten müssen.

Insbesondere das Auslösen von Emotionen, das Spiel mit Satire, der Umgang mit Sarkasmus, Unter-/Übertreibungen, An- und Doppeldeutigkeiten und die Verwendung von Intuition sind für einen guten Autor sicher kein größeres Problem, eher sein Handwerkszeug. Und für den Computer? (…)

Computer können nur bereits Vorhandenes neu kombinieren und verändern oder Neues per Zufall oder per vorgegebenem Algorithmus generieren. Menschliche Kreativität funktioniert anders! Dieses macht dann auch bei Bildern den Unterschied aus.“

Das Argument hat eine lange Geschichte. Alan Turing (1912–1954) ging bereits in seinem Artikel von 1950 darauf ein, in dem er den später nach ihm benannten Test vorschlug: Wenn wir schriftlich mit einem Computer und einem Menschen kommunizieren und nicht mehr sicher unterscheiden können, welcher Gesprächspartner Mensch und welcher Computer ist, dann müssten wir den Computer – ganz egal, wie er diese Leistung erbringt – für intelligent halten. Dieser Turing-Test ließe sich auf die bildende Kunst erweitern: Wenn wir ein von einem Computer geschaffenes Bild nicht mehr vom Werk eines Menschen unterscheiden können, müssen wir den Computer als Künstler und somit für kreativ ansehen.

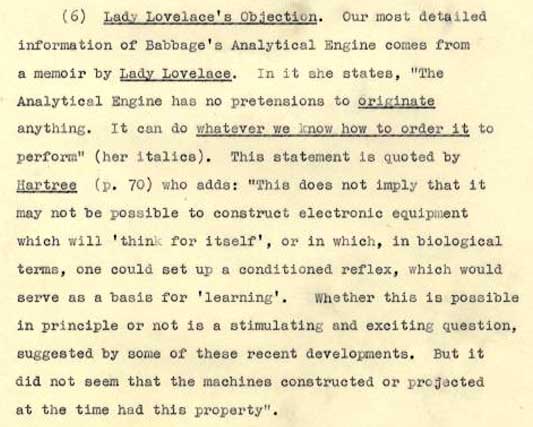

Das Gegenargument der fehlenden Kreativität und Originalität ist noch viel älter; es geht auf Augusta Ada Byron King, Countess of Lovelace (1815–1852) zurück, eine Mitarbeiterin des Mathematikers Charles Babbage (1791–1871), der mit seiner Analytical Engine den ersten universellen Computer erfunden hatte. Dieser mechanische Computer erwies sich als zu komplex, als dass er sich mit der damaligen Technik bauen ließ, aber Lady Lovelace beschäftigte sich bereits mit den nötigen Konzepten, um die Maschine für verschiedene – nicht nur mathematische – Aufgaben zu programmieren. Mangels eines funktionsfähigen Computers blieben ihre Überlegungen Theorie, aber sie war seinerzeit wohl die Einzige, die in diesem Zusammenhang wusste, wovon sie redete. Lady Lovelace schrieb:

„Die Analytical Engine erhebt nicht den Anspruch, irgendetwas zu erschaffen. Sie kann alles tun, von dem wir wissen, wie wir ihr vorschreiben können, es auszuführen.“

Man kann also sagen, dass die Kritik an der KI viel älter als die Anfänge der KI-Forschung selbst ist. Turing, der auf das Argument als „Lady Lovelace’s Objection“ einging, überzeugte es ein Jahrhundert später nicht.

Allerdings hatte auch Turing zwar schon seit 1947 die Idee der Künstlichen Intelligenz propagiert, verfügte aber nicht über eigene Erfahrungen mit KI-Systemen. Die Informatik steckte damals noch in den Kinderschuhen und die verfügbaren Computer waren nicht sehr leistungsfähig. Als eigentliche Geburtsstunde der KI gilt das Dartmouth Summer Research Project on Artificial Intelligence im Sommer 1956, zwei Jahre nach Turings tragischem Suizid. Turings ursprüngliche Vorstellung, ein Computer könne kreative Lösungen finden, indem er seinen eigenen Programmcode modifiziert, war in den folgenden Jahren kein Thema mehr – in der Informatik galt selbstmodifizierender Code bald als Teufelswerk.

Turings Interpretation des Einwands von Lady Lovelace war, dass uns ein Computer nicht überraschen könne. Aber ganz im Gegenteil hätten ihn Computer wie auch andere Maschinen schon oft überrascht, indem sie sich anders verhielten, als er vermutet hatte. Allerdings liegt das weniger am Computer als an unserem Unvermögen, stets die Auswirkungen unserer Handlungen vorauszusehen. Wie jeder weiß, der jemals einen Computer programmiert hat, tut ein Computer zwar stets das, was man ihm gesagt hat – aber nicht notwendigerweise das, was man meint, ihm gesagt zu haben. Turing gestand das ein, meinte aber, dass man die komplexen Schlussfolgerungen, die ein Computer ziehen kann, in der Praxis eben nicht im Voraus kennt und diese daher nicht trivialisieren dürfe.

Für die heute meist eingesetzten neuronalen Netze, die nicht programmiert werden, sondern die nötigen Parameter selbsttätig lernen, wenn man sie mit Inputs und den gewünschten Outputs trainiert, gilt das erst recht. Ein neuronales Netz ist zwar nicht, wie oft zu lesen, eine Black Box – wir kennen schließlich alle Parameter, die ihr Verhalten bestimmen. Aus dieser Masse an Zahlen herzuleiten, wie das neuronale Netz tut, was es tut, ist aber im wahrsten Sinne des Wortes eine Wissenschaft für sich. Wenn wir herausfinden wollen, wie ein Netz auf einen bestimmten Input reagiert, bleibt realistischerweise nur, es auszuprobieren.

Überraschungen sind also auch in der KI garantiert. Wenn einem das nicht reicht, müsste man sich die Frage stellen, ob der Mensch nicht ebenfalls ein vorprogrammiertes Verhalten zeigt. Wir sind nach dem Bauplan eines genetischen Codes entstanden und unsere Denkprozesse basieren auf einem Nervensystem, das nicht fundamental anders als die neuronalen Netze funktioniert, die vom biologischen Vorbild inspiriert sind. Wenn wir unsere Mitmenschen mit etwas Neuem überraschen können, dann vermutlich auch nur, weil unser Verhalten viel zu komplex ist, als dass es sich zuverlässig voraussagen ließe.

Aber Kreativität ist mehr als die Fähigkeit, zu überraschen, und sie ist auch nicht bloß die Folge eines komplexen Verhaltens. Komplexität ist nicht einmal der entscheidende Faktor. Es ist keineswegs so, dass eine immer höhere Komplexität (und, wie zu vermuten wäre, Intelligenz) an einem Punkt zu einem Umschlag von der Quantität in die Qualität führte – so dass sich ein KI-System irgendwann automatisch seiner selbst bewusst werden und, wie SF-Autoren nicht müde werden, uns weiszumachen, seine Schöpfer unterjochen oder wegen Nutzlosigkeit abschaffen würde.

Was den menschlichen Künstler dagegen auszeichnet, ist, dass er ein Leben lebt. Er hat gute und schlechte Erfahrungen gemacht, Menschen und Dinge kennengelernt. Er weiß, wie andere Menschen denken und empfinden, kann voraussehen, was in einer bestimmten Situation passieren wird – er kann eine Szene sehen und sich eine Geschichte dessen ausdenken, was vorher geschehen ist und was nachher passieren wird. Eben deshalb ist der Künstler, worauf unser Leser Andre Möschter ganz richtig verweist, zu Ironie und Sarkasmus fähig. Er kann Dinge in Beziehung setzen und das so darstellen, dass sich dem Betrachter diese Beziehung erschließt. Der Künstler weiß, was er darstellt, und er weiß, was er tut; er verarbeitet nicht bloß bedeutungslose Formen, um neue, ebenso bedeutungslose Formen zu erzeugen.

Ist KI intelligent, aber nicht kreativ?

Das heißt wohlgemerkt nicht, dass ein KI-System nicht ebenfalls dazu fähig sein könnte. Wir verfügen ja auch nicht über irgendeine magische Zutat, eine Seele oder einen belebenden göttlichen Odem, die uns zur Kreativität befähigt und die Computern abginge. Vielleicht wird es irgendwann die C3POs und R2D2s geben, die uns die Science Fiction schon lange verspricht, und diese könnten dann nicht bloß das Abendessen kochen und unser Raumschiff warten, sondern auch künstlerisch tätig werden. Eine Androidenkunst würde ich tatsächlich gerne sehen, auch wenn ich nicht ernsthaft erwarte, das noch zu erleben. Keines der KI-Systeme, mit denen wir es heute zu tun haben, erfüllt auch nur annähernd diese Voraussetzungen, und so lange die KI-Forschung keine neue Richtung einschlägt, wird sich daran auch nichts ändern.

Danke für diesen ausführlichen und aufschlußreichen Beitrag. DocB